AI poate genera radiografii false care păcălesc peste 50% din medici și chiar aplicații AI

Un studiu recent atrage atenția asupra unui risc major din domeniul medical: imagini radiologice false, generate de inteligența artificială, pot păcăli inclusiv radiologi experimentați.

Cercetarea, citată de revista Nature, evidențiază vulnerabilitățile serioase pe care această tehnologie le introduce în sistemele de diagnostic.

Studiu internațional: cât de ușor pot fi confundate imaginile

În cadrul cercetării, 17 radiologi din 12 spitale, situate în șase țări, au analizat un set de 264 de radiografii.

Citește și: „Dacă băieții ăștia îl dau jos pe Bolojan, Bolojan mai câștigă zece procente” - Daniel Fenechiu

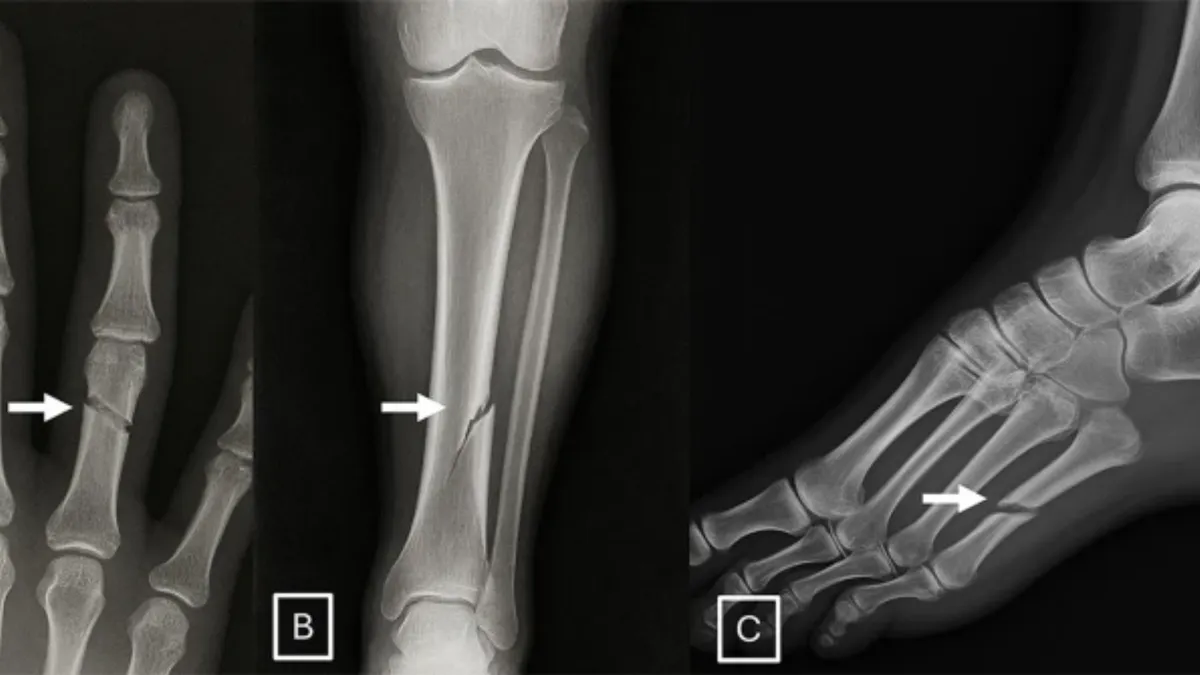

Jumătate dintre acestea erau imagini sintetice, create cu ajutorul unor instrumente de inteligență artificială precum ChatGPT sau RoentGen.

Rezultatele au fost îngrijorătoare: atunci când medicii nu știau că participă la un test privind imaginile generate de AI, doar 41% au reușit să identifice corect radiografiile false.

Precizia crește când radiologii sunt avertizați

După ce participanții au fost informați că unele imagini sunt generate artificial, capacitatea lor de a face diferența între radiografiile reale și cele sintetice a crescut semnificativ, ajungând la o precizie medie de 75%.

Datele au fost publicate în revista de specialitate Radiology și subliniază importanța conștientizării în fața noilor tehnologii.

Riscuri majore: fraude medicale și atacuri cibernetice

Coordonatorul studiului, Dr. Mickael Tordjman, de la Școala de Medicină Icahn din cadrul Mount Sinai din New York, avertizează asupra implicațiilor grave ale acestor descoperiri.

Potrivit acestuia, existența unor radiografii false extrem de realiste deschide calea unor posibile fraude medicale.

De exemplu, o fractură generată artificial ar putea deveni imposibil de diferențiat de una reală, ceea ce ar putea influența procese legale sau decizii medicale critice.

În plus, există și un risc semnificativ de securitate cibernetică.

Hackerii ar putea compromite sistemele informatice ale spitalelor și introduce imagini false în dosarele pacienților, manipulând diagnosticele sau generând haos în activitatea clinică.

Nici inteligența artificială nu detectează perfect falsurile

Studiul a analizat și performanța mai multor modele de inteligență artificială în identificarea imaginilor false.

Printre acestea s-au numărat GPT-4o și GPT-5 (OpenAI), Gemini 2.5 Pro (Google) și Llama 4 Maverick (Meta).

Rezultatele au variat semnificativ, cu rate de detecție cuprinse între 57% și 85%.

Chiar și modelul care a generat imaginile false, GPT-4o, nu a reușit să le identifice pe toate, deși a avut cele mai bune rezultate dintre sistemele testate.

„Doar vârful aisbergului”: pericolele viitoare

Autorii studiului avertizează că situația actuală ar putea reprezenta doar începutul.

În viitor, imagini mult mai complexe, precum scanările CT sau RMN, ar putea fi falsificate cu același grad de realism.

În acest context, dezvoltarea unor baze de date educaționale și a unor instrumente eficiente de detectare devine esențială pentru protejarea sistemului medical și menținerea încrederii în diagnosticele digitale.